3: Introducción al Cálculo Multivariante

- Page ID

- 93057

\( \newcommand{\vecs}[1]{\overset { \scriptstyle \rightharpoonup} {\mathbf{#1}} } \)

\( \newcommand{\vecd}[1]{\overset{-\!-\!\rightharpoonup}{\vphantom{a}\smash {#1}}} \)

\( \newcommand{\dsum}{\displaystyle\sum\limits} \)

\( \newcommand{\dint}{\displaystyle\int\limits} \)

\( \newcommand{\dlim}{\displaystyle\lim\limits} \)

\( \newcommand{\id}{\mathrm{id}}\) \( \newcommand{\Span}{\mathrm{span}}\)

( \newcommand{\kernel}{\mathrm{null}\,}\) \( \newcommand{\range}{\mathrm{range}\,}\)

\( \newcommand{\RealPart}{\mathrm{Re}}\) \( \newcommand{\ImaginaryPart}{\mathrm{Im}}\)

\( \newcommand{\Argument}{\mathrm{Arg}}\) \( \newcommand{\norm}[1]{\| #1 \|}\)

\( \newcommand{\inner}[2]{\langle #1, #2 \rangle}\)

\( \newcommand{\Span}{\mathrm{span}}\)

\( \newcommand{\id}{\mathrm{id}}\)

\( \newcommand{\Span}{\mathrm{span}}\)

\( \newcommand{\kernel}{\mathrm{null}\,}\)

\( \newcommand{\range}{\mathrm{range}\,}\)

\( \newcommand{\RealPart}{\mathrm{Re}}\)

\( \newcommand{\ImaginaryPart}{\mathrm{Im}}\)

\( \newcommand{\Argument}{\mathrm{Arg}}\)

\( \newcommand{\norm}[1]{\| #1 \|}\)

\( \newcommand{\inner}[2]{\langle #1, #2 \rangle}\)

\( \newcommand{\Span}{\mathrm{span}}\) \( \newcommand{\AA}{\unicode[.8,0]{x212B}}\)

\( \newcommand{\vectorA}[1]{\vec{#1}} % arrow\)

\( \newcommand{\vectorAt}[1]{\vec{\text{#1}}} % arrow\)

\( \newcommand{\vectorB}[1]{\overset { \scriptstyle \rightharpoonup} {\mathbf{#1}} } \)

\( \newcommand{\vectorC}[1]{\textbf{#1}} \)

\( \newcommand{\vectorD}[1]{\overrightarrow{#1}} \)

\( \newcommand{\vectorDt}[1]{\overrightarrow{\text{#1}}} \)

\( \newcommand{\vectE}[1]{\overset{-\!-\!\rightharpoonup}{\vphantom{a}\smash{\mathbf {#1}}}} \)

\( \newcommand{\vecs}[1]{\overset { \scriptstyle \rightharpoonup} {\mathbf{#1}} } \)

\(\newcommand{\longvect}{\overrightarrow}\)

\( \newcommand{\vecd}[1]{\overset{-\!-\!\rightharpoonup}{\vphantom{a}\smash {#1}}} \)

\(\newcommand{\avec}{\mathbf a}\) \(\newcommand{\bvec}{\mathbf b}\) \(\newcommand{\cvec}{\mathbf c}\) \(\newcommand{\dvec}{\mathbf d}\) \(\newcommand{\dtil}{\widetilde{\mathbf d}}\) \(\newcommand{\evec}{\mathbf e}\) \(\newcommand{\fvec}{\mathbf f}\) \(\newcommand{\nvec}{\mathbf n}\) \(\newcommand{\pvec}{\mathbf p}\) \(\newcommand{\qvec}{\mathbf q}\) \(\newcommand{\svec}{\mathbf s}\) \(\newcommand{\tvec}{\mathbf t}\) \(\newcommand{\uvec}{\mathbf u}\) \(\newcommand{\vvec}{\mathbf v}\) \(\newcommand{\wvec}{\mathbf w}\) \(\newcommand{\xvec}{\mathbf x}\) \(\newcommand{\yvec}{\mathbf y}\) \(\newcommand{\zvec}{\mathbf z}\) \(\newcommand{\rvec}{\mathbf r}\) \(\newcommand{\mvec}{\mathbf m}\) \(\newcommand{\zerovec}{\mathbf 0}\) \(\newcommand{\onevec}{\mathbf 1}\) \(\newcommand{\real}{\mathbb R}\) \(\newcommand{\twovec}[2]{\left[\begin{array}{r}#1 \\ #2 \end{array}\right]}\) \(\newcommand{\ctwovec}[2]{\left[\begin{array}{c}#1 \\ #2 \end{array}\right]}\) \(\newcommand{\threevec}[3]{\left[\begin{array}{r}#1 \\ #2 \\ #3 \end{array}\right]}\) \(\newcommand{\cthreevec}[3]{\left[\begin{array}{c}#1 \\ #2 \\ #3 \end{array}\right]}\) \(\newcommand{\fourvec}[4]{\left[\begin{array}{r}#1 \\ #2 \\ #3 \\ #4 \end{array}\right]}\) \(\newcommand{\cfourvec}[4]{\left[\begin{array}{c}#1 \\ #2 \\ #3 \\ #4 \end{array}\right]}\) \(\newcommand{\fivevec}[5]{\left[\begin{array}{r}#1 \\ #2 \\ #3 \\ #4 \\ #5 \\ \end{array}\right]}\) \(\newcommand{\cfivevec}[5]{\left[\begin{array}{c}#1 \\ #2 \\ #3 \\ #4 \\ #5 \\ \end{array}\right]}\) \(\newcommand{\mattwo}[4]{\left[\begin{array}{rr}#1 \amp #2 \\ #3 \amp #4 \\ \end{array}\right]}\) \(\newcommand{\laspan}[1]{\text{Span}\{#1\}}\) \(\newcommand{\bcal}{\cal B}\) \(\newcommand{\ccal}{\cal C}\) \(\newcommand{\scal}{\cal S}\) \(\newcommand{\wcal}{\cal W}\) \(\newcommand{\ecal}{\cal E}\) \(\newcommand{\coords}[2]{\left\{#1\right\}_{#2}}\) \(\newcommand{\gray}[1]{\color{gray}{#1}}\) \(\newcommand{\lgray}[1]{\color{lightgray}{#1}}\) \(\newcommand{\rank}{\operatorname{rank}}\) \(\newcommand{\row}{\text{Row}}\) \(\newcommand{\col}{\text{Col}}\) \(\renewcommand{\row}{\text{Row}}\) \(\newcommand{\nul}{\text{Nul}}\) \(\newcommand{\var}{\text{Var}}\) \(\newcommand{\corr}{\text{corr}}\) \(\newcommand{\len}[1]{\left|#1\right|}\) \(\newcommand{\bbar}{\overline{\bvec}}\) \(\newcommand{\bhat}{\widehat{\bvec}}\) \(\newcommand{\bperp}{\bvec^\perp}\) \(\newcommand{\xhat}{\widehat{\xvec}}\) \(\newcommand{\vhat}{\widehat{\vvec}}\) \(\newcommand{\uhat}{\widehat{\uvec}}\) \(\newcommand{\what}{\widehat{\wvec}}\) \(\newcommand{\Sighat}{\widehat{\Sigma}}\) \(\newcommand{\lt}{<}\) \(\newcommand{\gt}{>}\) \(\newcommand{\amp}{&}\) \(\definecolor{fillinmathshade}{gray}{0.9}\)Presentamos inicialmente algunos conceptos como los de función multivariante, derivada parcial, gradiente, así como la composición de funciones de varias variables y la regla de la cadena para su derivación. Todos ellos serán imprescindibles en el desarrollo subsiguiente, en el que se introduce un algoritmo de aprendizaje supervisado muy utilizado para entrenar redes neuronales. Nos valdremos para ello del método del gradiente descendente, en cuya aplicación efectiva se emplea la estrategia de retropropagación, indicada para el cálculo del gradiente de funciones mediante la aplicación recursiva de la regla de la cadena.

Definición 1. Una función \(\textbf{f}: \mathbb{R}^n \rightarrow \mathbb{R}^k\) lleva \(\textbf{x} \in \mathbb{R}^n\) en \(\textbf{y}=\textbf{f}(\textbf{x})\in \mathbb{R}^k\). Se dice que \(\mathbb{R}^n\) es el dominio de \(\textbf{f}\) y para cada \(\textbf{x} \in \mathbb{R}^n\), el vector \(\textbf{y}=\textbf{f}(\textbf{x})\) es la imagen de \(\textbf{x}\) por \(\textbf{f}\). El conjunto de todas las imágenes se denomina también imagen de \(\textbf{f}\).

- \(\textbf{x} = (x_1,\dots ,x_n)^T\).

- \(\textbf{f(x)} = (f_{1}(\textbf{x}),\dots, f_{k}(\textbf{x}))^T\) y cada \(f_i(\textbf{x})\) es una función coordenada de \(\textbf{f}\).

- Si \(k = 1\), \(f(\textbf{x})\in \mathbb{R}\).

Observación \(\PageIndex{1}\)

Los vectores \(\textbf{x} \in \mathbb R^n\) son vectores columna. Por comodidad, usamos la notación \(\textbf{x} = (x_1,\dots ,x_n)^T\) para indicar el traspuesto del vector fila \((x_1,\dots ,x_n)\). En ocasiones preferiremos la notación \(\textbf{f}(x,y)\), que resulta más simple que \(\textbf{f}((x,y)^T)\).

Funciones Lineales

Para números reales fijos \(a_1, a_2, a_3\), la función lineal \(f\) de dominio \(\mathbb{R}^3\) dada por \(f(x_1, x_2, x_3)=a_1 x_1+ a_2 x_2 + a_3 x_3\) cumple que fijadas dos de las variables.

Por ejemplo \(x_1=-3\) y \(x_2=5\), la función \(g(x_3)=-3 a_1 + 5 a_2 + a_3 x_3\) es una función lineal.

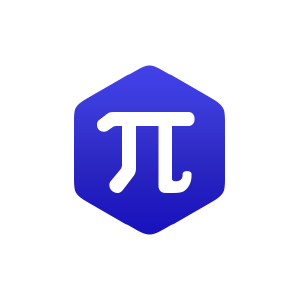

Consideramos la función \(f(x,y)=x^2+y^2\), con dominio \(\mathbb{R}^2\) e imagen en \(\mathbb{R}\). El valor mı́nimo que toma la función es \(0\), en el punto \((0,0)\). En todos los puntos \((x,y)\) que estén sobre la circunferencia centrada en \((0,0)\) y radio \(r>0\), la función \(f\) toma el valor \(r^2\). Si fijamos una de las variables, por ejemplo \(y=3\), obtenemos la función \(g(x)=x^2+9\), cuya gráfica es una parábola. Podemos represintar la función \(f\), que es la superficie de \(\mathbb R^3\) de la gráfica siguiente:

Observación \(\PageIndex{2}\)

Cuando trabajemos con una función \(f: \mathbb{R}^n \rightarrow \mathbb{R}\) y fijemos \(n-1\) variables, obtenemos una función con dominio e imagen en \(\mathbb{R}\), que podemos analizar con las técnicas ya conocidas.

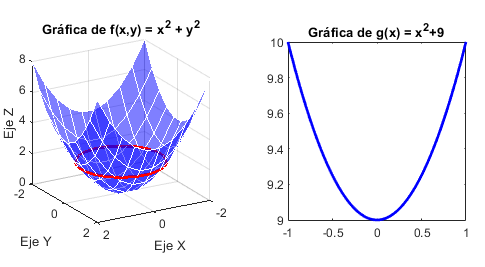

La función \(\textbf{f}: \mathbb R \to \mathbb R^2\) dada por \(\textbf{f}(t)= (\cos(t),\sin(t))\) viene definida por las funciones coordenadas \(f_1(t)=\cos(t)\) y \(f_2(t)=\sin(t)\). La gráfica de \(\textbf{f}\) es una hélice contenida en \(\mathbb R^3\). La imagen de \(\textbf{f}\) es el conjunto \(C:=\{(x,y) \in \mathbb R^2:x^2+y^2=1\}\), ya que para todo \(t \in \mathbb R\) se cumple que \(\cos^2(t)+\sin^2(t)=1\) .

Nos encontraremos con la función sigmoide \(\sigma(x)=\dfrac{1}{1+e^{-x}}\), que es derivable y (¡Compruébalo!) su derivada es \(\sigma '(x)=\sigma(x)(1-\sigma(x))\)

Revisamos para una función \(f: \mathbb{R} \rightarrow \mathbb{R}\) (es decir: \(n=k =1\)), la noción de derivada en un punto \(x\).

La derivada de \(f\) en \(x\), que notamos \(f'(x)\), viene dada (¡Cuando existe!) por: \[\lim_{h \to 0} \dfrac{f(x+h)-f(x)}{h}\]

Recuerda que \(f'(x)\) es la pendiente de la recta que más se asemeja a la gráfica de la función entre las que pasan por el punto \((x,f(x))\). Como la recta que une los puntos \((a,b)\) y \((c,d)\) tiene pendiente \(\dfrac{d-b}{c-a}\), la recta que une \((x,f(x))\) con \((x+h,f(x+h))\) tiene como pendiente \(\dfrac{f(x+h)-f(x)}{h}\), por lo que \(f'(x)\) es el lı́mite de las pendientes de estas rectas.

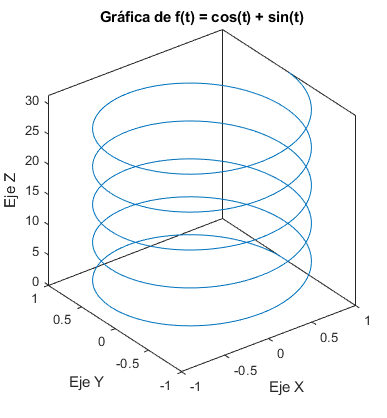

Si \(f:\mathbb R \to \mathbb R\) cumple que \(f(3)=1\) y \(f'(3)=2\), el valor \(f(3)\) no puede ser mı́nimo (ni máximo), ya que la gráfica cerca de \(3\) es similar a la recta \(y=f(3)+f'(3)(x-3)=1+2(x-3)\); es decir, \(y=2x-5\).

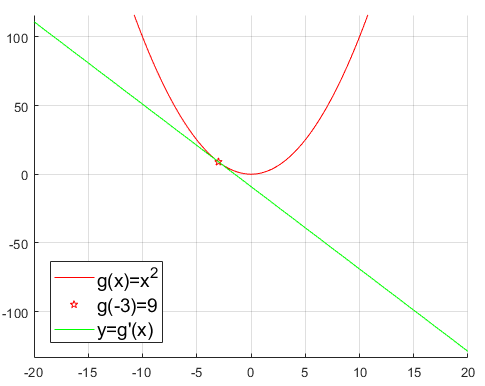

Si pensamos en la función \(g(x)=x^2\) y \(x=-3\), como \(g'(-3)=-6\), a la derecha de \(-3\) la función tomará valores menores que \(g(-3)=9\). El valor mı́nimo de la función, que es \(g(0)=0\), se alcanza en un punto donde la derivada es nula.

La derivada parcial de la función \(f: \mathbb{R}^n \rightarrow \mathbb{R}\) con respecto a la variable \(x_j\) en \(\textbf{x}=(x_1,\dots, x_{j-1}, x_j,x_{j+1},\dots , x_n)^T\), que denotamos \(\dfrac{\partial}{\partial x_j}f(\textbf{x})\), viene dada por \[\lim_{h \to 0} \dfrac{f(x_1,\dots, x_{j-1}, x_j+h,x_{j+1},\dots , x_n)-f(x_1,\cdots, x_{j-1}, x_j,x_{j+1},\dots , x_n)}{h}\]

La función \(f(x,y)=x^2+y^2\) tiene como derivadas parciales \(\dfrac{\partial}{\partial x}f(x,y)=2x\) y \(\dfrac{\partial}{\partial y} f(x,y)=2y\). La función \(f(x_1, x_2, x_3)=a_1 x_1+ a_2 x_2 + a_3 x_3\) tiene como derivada parcial con respecto a \(x_j\) el número \(a_j\), para \(1\leq j \leq 3\). La función \(f(x,y)=\sin(xy^3)+x^2y\) tiene como derivadas parciales \(\dfrac{\partial}{\partial x}f(x,y)=y^3\cdot \cos(xy^3)+2xy\) y \(\dfrac{\partial}{\partial y} f(x,y)=3xy^2\cos(xy^3)+x^2\).

Dada una función \(f: \mathbb{R}^n \rightarrow \mathbb{R}\) con derivadas parciales \(\dfrac{\partial}{\partial x_j}f(\textbf{x})\), el gradiente de \(f\) se denota por \(\nabla f(\textbf{x})\) y tiene por coordenadas las funciones \(\dfrac{\partial}{\partial x_j}f(\textbf{x})\), con \(1\leq j \leq n\).

La función \(f(x,y)=x^2+y^2\) tiene como gradiente la función \(\nabla f(x,y)=(2x,2y)^T\). La función \(f(x_1, x_2, x_3)=a_1 x_1+ a_2 x_2 + a_3 x_3\) tiene como gradiente el vector constante \(\nabla f(\textbf x)=(a_1,a_2,a_3)^T\).

Observación \(\PageIndex{3}\)

Como veremos más adelante, el hecho de que la dirección del gradiente \(\nabla f(\textbf{x})\) sea la de máximo crecimiento de la función \(f\) en cada punto \(\textbf{x}\) y la dirección dada por su opuesto, \(-\nabla f(\textbf{x})\), la de mayor decrecimiento, permite establecer una estrategia para minimizar la función escalar \(f(\textbf{x})\). Para la función \(f(x,y)=x^2+y^2\) en el punto \((-3,4)\) hemos elegido valores \((h_1,h_2)\) de signos opuestos al gradiente \((-6,8)\) para obtener puntos \((-3+h_1,4+h_2)\) en los que \(f\) toma valores menores que \(f(-3,4)=25\).

Si trabajamos con una función \(\textbf{f}: \mathbb{R}^n \rightarrow \mathbb{R}^k\) de \(k\) coordenadas \(f_1,f_2,\dots,f_k\), cuando existan las \(n\) derivadas parciales de cada una de ellas podemos considerar la función matricial de \(k\) filas y \(n\) columnas formada por los \(k\) gradientes \(\nabla f_k\). Se trata de la matriz jacobiana de la función \(\textbf{f}\).